近日,科技媒体 The Decoder 发布博文,报道称微软以预览版的形式,在 Azure AI Content Safety 中推出 Groundedness Detection,用于“纠正” AI 幻觉。

AI 幻觉

在人工智能领域中,幻觉是由人工智能生成的一种回应,它含有貌似事实的虚假或误导性资讯。

该术语源自幻觉的心理学概念,因为它们具有相似的特征。人工智能幻觉的危险之处之一是模型的输出看起来是正确的,而它实际上是错误的。

Groundedness Detection

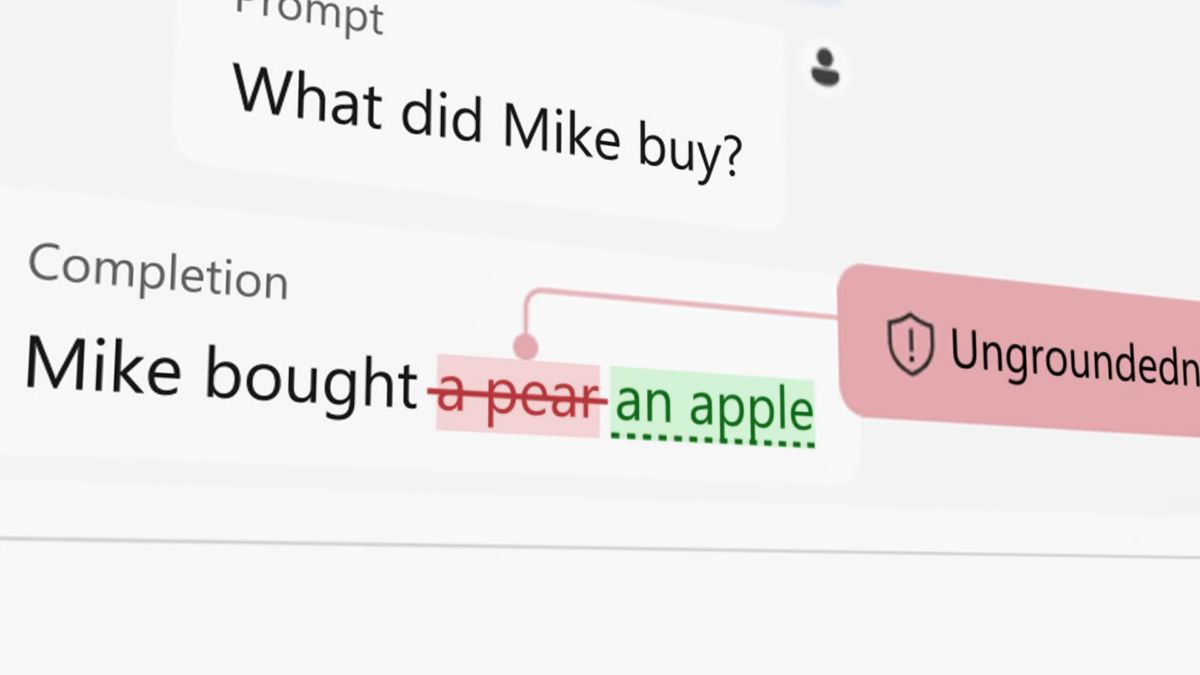

微软的 Groundedness Detection 类似于谷歌在 Vertex AI 中推出的 Google Search Grounding,主要对比 AI 输出内容和源文件,从而识别没有证据或者幻觉内容。

微软强调,虽然该工具提高了人工智能输出的可靠性,但并不能保证完全准确,只是能提高生成内容与源材料之间的一致性。

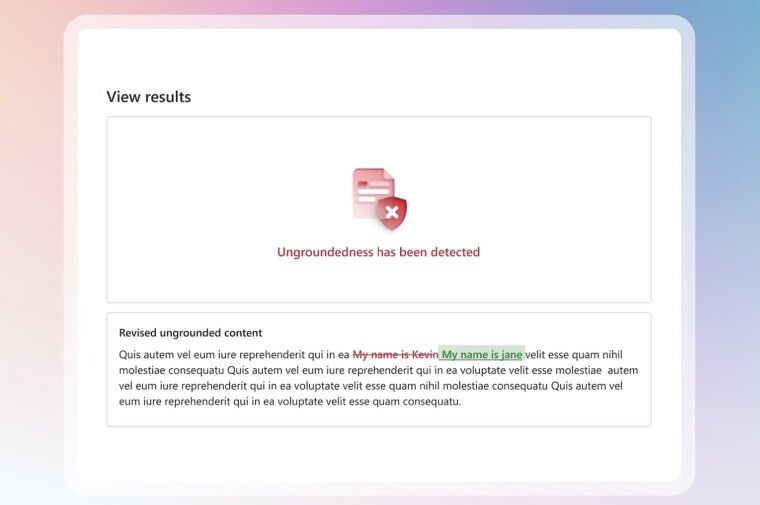

当系统检测到一个支持不足的句子时,就会触发一个新的请求,要求一个较小的人工智能模型进行修正,该模型会根据基础文档对句子进行评估。

如果一个句子不包含基础文档中的相关信息,它就会被完全过滤掉。对于包含一些相关内容的句子,模型会对其进行改写,匹配源材料。

免责声明:素材源于网络,如有侵权,请联系删稿。

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。